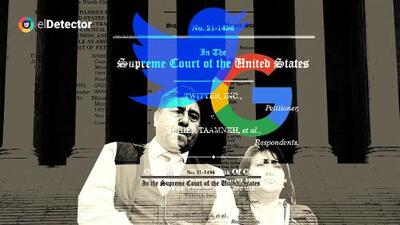

¿Twitter y Google son responsables de los actos terroristas de ISIS? La decisión que tiene en sus manos la Corte Suprema y su impacto

La Corte Suprema de Estados Unidos revisará este año dos demandas judiciales que pueden cambiar para siempre el uso de internet y la responsabilidad de las plataformas de redes sociales sobre el contenido que exhiben. Hablemos de González vs. Google y de Twitter vs. Taamneh.

Los dos casos son sencillos y reflejan los peligros de internet. Plantean preguntas importantes sobre las responsabilidades de las compañías cuando se trata de moderar el contenido en línea y hasta qué punto pueden ser responsables por las acciones de sus usuarios, incluso en el mundo offline.

El primero, González vs. Google, viene de la familia de Nohemí González, muerta en un ataque terrorista del autodenominado Estado Islámico (ISIS, por sus siglas en inglés), realizado en París en 2015.

Los familiares de la víctima quieren que la Corte Suprema de Estados Unidos considere a Google –empresa dueña de YouTube– responsable de haber dejado que videos extremistas aparecieran en la plataforma como "sugerencia de contenido". Para los familiares, las grabaciones llevaron a la radicalización política de los terroristas y el hecho de que YouTube sugería que sus usuarios las vieran tiene conexión con la muerte.

La discusión de fondo en este caso va mucho más allá del triste episodio terrorista.

Los jueces van a tener que decidir si los algoritmos de recomendación utilizados por las redes sociales están o no están protegidos por la sección 230 de la Ley de Decencia en las Comunicaciones. Y este documento, vigente hoy día, establece que, a diferencia de los medios de comunicación, las plataformas no son responsables de los contenidos creados por terceros que ellas exhiben o distribuyen. Para la familia González, sin embargo, esto no debería aplicarse a los algoritmos de recomendación, puesto que indudablemente son creados por las empresas y deberían ser de su total responsabilidad.

La argumentación oral del caso ocurrió el 21 de febrero de 2023 y duró tres horas. Este es el primer paso en el proceso judicial de la Corte. Los González quieren que Google les recompense por la pérdida de Nohemí –y esto parece lógico. Pero, al final de la sesión, varios especialistas subrayaron la posibilidad de que una decisión en favor de los González abra la puerta para miles y miles de demandas semejantes y que las plataformas pasen a adoptar una especie de censura previa de contenidos, lo que obviamente impactaría en la libertad de expresión.

El segundo caso, Twitter vs. Taamneh, se asemeja al anterior. Todo empezó en el Año Nuevo de 2017, cuando un hombre entró armado en una discoteca de Estambul, en Turquía, y mató a 39 personas. Entre ellas estaba el jordano Nawras Alassaf, que tiene familia en Estados Unidos. ISIS asumió la responsabilidad del ataque, pero los familiares de Alassaf creen que también Twitter debería hacerlo.

Lo que está en discusión aquí es la aplicación de la Ley de Justicia contra los Patrocinadores del Terrorismo (JASTA, en inglés). Desde 2016, esta norma permite que cualquier ciudadano de Estados Unidos herido en un acto de terrorismo demande ante la justicia a aquellos que "ayudan y son cómplices, proporcionando a sabiendas una asistencia sustancial” al terrorista.

Imagina la cantidad de demandas que pueden llegar a las cortes estadounidenses si Twitter pierde este caso. Por lo que se vio en la primera audiencia del caso, la Corte Suprema está dividida. Los jueces conservadores parecen más alineados con los defensores de Twitter; los liberales, más del lado de los demandantes.

Y aquí hay otro motivo para estar atento a ambas demandas. Además de obligarnos a pensar con cuidado sobre las responsabilidades de las big techs y sobre su deber de proteger a sus usuarios de contenido perjudicial, estos dos casos pueden confirmar la politización del poder judicial estadounidense. Y esto nunca está bien.

Si la Corte Suprema falla a favor de los demandantes en cualquiera de estos casos, es muy posible que las plataformas tomen un papel más proactivo en la moderación del contenido –lo que no necesariamente es bueno. Si falla en contra de los demandantes, estará dando carta blanca para que las grandes compañías tecnológicas descuiden sus algoritmos. O sea, estamos delante de una historia jurídica que tendrá –sí o sí– impacto en nuestro futuro. Y en breve.

Cristina Tardáguila es directora de ICFJ y fundadora de Lupa.

Envíanos al chat algo que quieres que verifiquemos. Pincha aquí: